Aturan belajar perceptron lebih handal daripada aturan Hebb. Dengan asumsi yang sesuai prosedur belajar iteratifia dapat dibuktikan konvergen ke bobot yang benar yakni bobot yang memungkinkan jaringan menghasilkan nilai keluaran yang benar untuk setiap pola masukan pelatihan.

Beberapa tipe perceptron yang berbeda dijelaskan oleh Rosemblat (1962) dan Minsky & Papert (1969,1988) Walau beberapa perceptron adalah swa-organisasi (self organizing), tetapi sebagian besar dilatih.

Perceptron pada mulanya mempunyai tiga lapis neuron : yaitu unit sensori, unit asosiator, dan unit tanggapan, sehingga membentuk model pendekatan retina. Perceptron khusus yang sederhana (Block, 1962) menggunakan aktivasi biner untuk unit sensori dan unit asosiator, dan aktivasi +1, 0, atau —1 untuk unit tanggapan. Unit sensori terhubung ke unit asosiator dengan koneksi bobot tetap yang bemilai +1, 0 atau —1 yang ditetapkan secara acak.

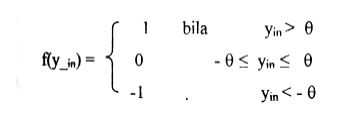

Fungsi aktivasi untuk setiap unit asosiator adalah fiingsi undak biner dengan ambang tetap sembarang, Sehingga sinyal yang dikirim dari unit asosiator ke unit keluaran adalah sinyal biner (0 atau 1). Keluaran perceptron adalah y = f(y_in) dengan fungsi aktivasinya adalah:

Bobot dari unit asosiator ke unit tanggapan (keluaran) diatur dengan aturan belajar perceptron. Untuk setiap masukan pelatihan, jaringan menghitung tanggapan unit keluaran. Kemudian jaringan menentukan apakah galat terjadi pada unit keluaran (dengan membandingkan keluaran terhitung dengan nilai target). Jaringan tidak membedakan galat bila keluaran terhitung nol dan target -1 atau 1. Lain halnya bila keluaran terhitung +1 dan target -1 .

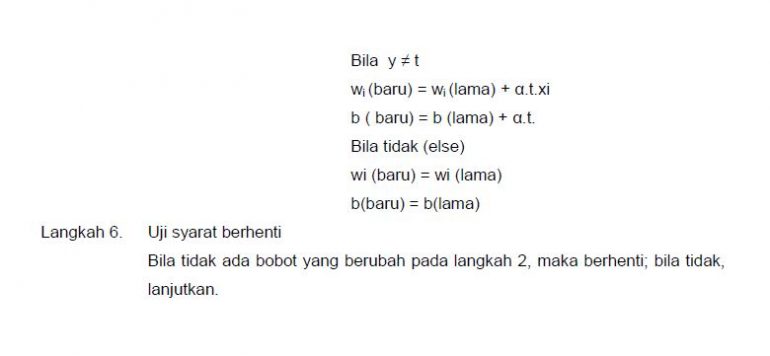

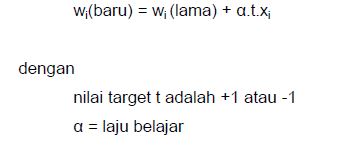

Dalam kasus ini tanda galat menunjukkan bahwa bobot harus diubah dalam arah yang ditunjukkan oleh nilai target tetapi hanya bobot koneksi dan unit yang mengirim sinyal non zero ke unit output yang diatur, (karena sinyal ini menyumbang galat). Bila galat terjadi untuk pola masukan pelatihan tertentu, maka bobot harus diubah menurut formula berikut:

Bila tidak terjadi galat, maka bobot tidak diubah. Pelatihan berlanjut sampai tidak terjadi dalat.

Arsitektur Perceptron

Karena hanya bobot dari unit asosiator ke unit keluaran yang diatur, maka peninjauan dibatasi pada bagian jaringan lapis tunggal. Jadi unit asosiator berftingsi seperti unit masukan (lihat Gambar 2.2).

Tujuan jaringan adalah mengklasiflkasi setiap pola masukan, apakah menjadi anggota atau bukan dari suatu kelas. Menjadi anggota dinyatakan dengan unit keluaran yang memberikan tanggapan +1. Bukan anggota ditunjukkan oleh tanggapan. Jaringan dilatih untuk melakukan klasifikasi dengan teknik iterative dan diberikan oleh algoritma berikut:

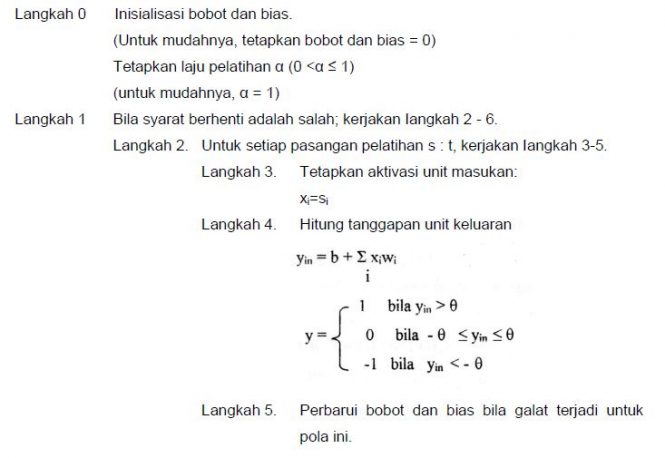

Algoritma Perceptron

Algoritma ini cocok untuk vektor masukan baik biner atau bipolar (n-tupel), dengan target bipolar, θ tetap, dan prasikap dapat diatur. Ambang θ tidak mempunyai peran ia seperti fungsi undak sebelumnya, sehingga prasikap (bias) dan ambang diperlukan Peranan ambang dibahas setelah algoritma berikut. Algoritma tidak sensitif terhadap nilai awal bobot atau laju pelatihan. Langkah-langkah algoritma adalah sebagai :